Бяспека штучнага інтэлекту? Заява ў Блетчлі-парку мае вырашальнае значэнне

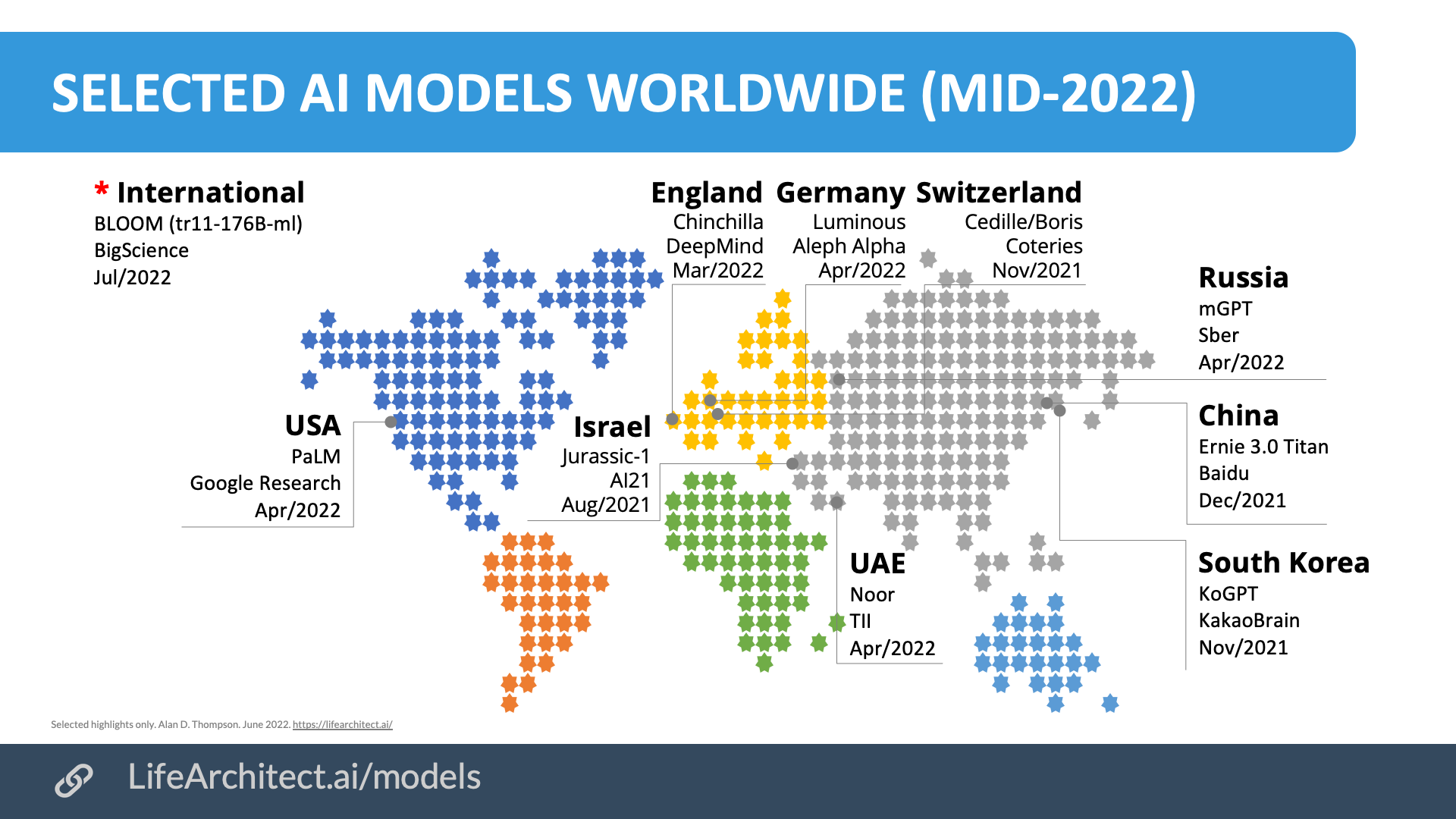

У дэталях важная ініцыятыва, санкцыянаваная асноўнымі краінамі-пратаганістамі сусветнага прагрэсу ў галіне штучнага інтэлекту

Апошнія 1 і 2 лістапада падчас в Саміт бяспекі штучнага інтэлекту, адбылася ў Вялікабрытаніі ў Блетчли-Парк, у графстве Бакінгемшыр, 28 краін падпісалі дэкларацыю аб намерах адносна развіцця штучнага інтэлекту ў бяспечных умовах.

AI: Вайна, якая вось-вось пачнецца, будзе не такой, якой мы чакаем

SwissGPT: швейцарскі штучны інтэлект, які робіць рэвалюцыю ў карпаратыўнай бяспецы

Фотагалерэя, будучыня лічбавай трансфармацыі ў Ліхтэнштэйне

Месца з высокай сімвалічнай каштоўнасцю, да лепшага ці да горшага...

Месца правядзення саміту, Блетчли-Парк, быў цэнтрам расшыфроўкі падчас Другой сусветнай вайны, дзе Алан Т'юрынг і яго каманда працавала над стварэннем «Крыстафер», вылічальная машына, якой удалося падарваць код Загадка, нямецкая прылада, якая выкарыстоўвалася для кадзіравання сакрэтных ваенных паведамленняў, да таго часу лічылася матэматычна непрыступнай.

Месца з асабліва высокай сімвалічнай каштоўнасцю, паколькі было падлічана, што дзякуючы ангельскаму вучонаму вайна працягвалася на два гады менш, выратаваўшы прынамсі 14 мільёнаў жыццяў.

На жаль, гэтае ж месца таксама сімвалізуе фундаментальную абыякавасць і няўдзячнасць многіх урадаў да сваіх выратавальнікаў, улічваючы, што Алан Цьюрынг скончыў жыццё самагубствам у 1954 годзе пасля года "хімічнай кастрацыі", накладзенай на яго за яго гомасэксуалізм, з гратэскавым канцом каралеўскай " пасмяротнае памілаванне". у 2013 годзе, як быццам гэта ён павінен быў за нешта загладзіць.

Усё гэта таксама прымушае нас задацца пытаннем аб цяперашнім падыходзе вышэйшых уладаў да праблем, якія ўзніклі ў выніку нядаўняга «выбуху» тэхналогій, звязаных са штучным інтэлектам.

Швейцарыя і ЗША дамовіліся аб кібербяспецы і лічбавых тэхналогіях

Вада, трава і чалавецтва: кагнітыўныя межы штучнага інтэлекту

Штучны інтэлект таксама для распрацоўкі новых лекаў

Але давайце паглядзім, што ўтрымлівае дэкларацыя аб намерах

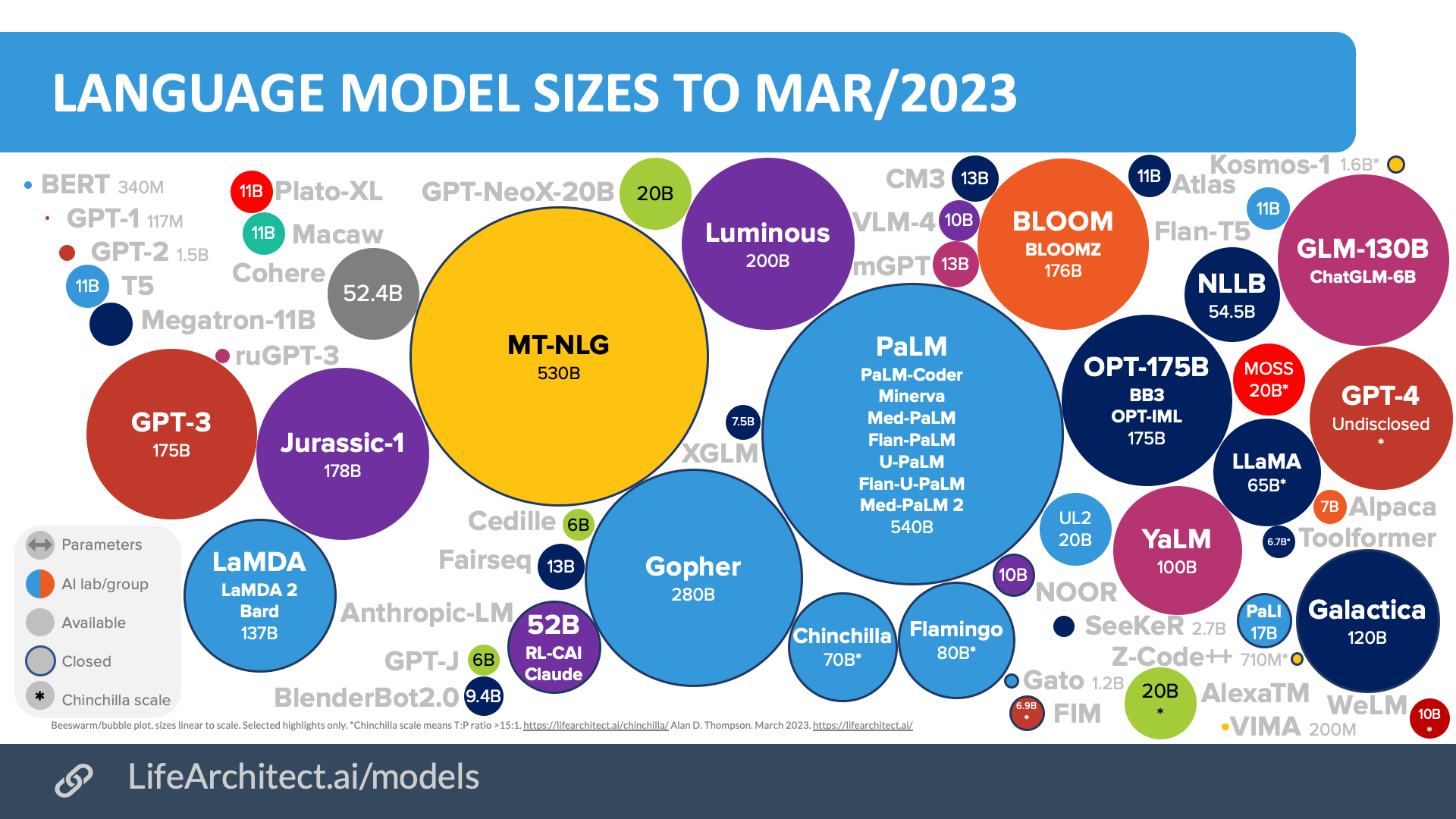

Пасля кароткага аналізу магчымасцей для паляпшэння, якія прапануе штучны інтэлект у розных сектарах чалавечай дзейнасці, і прызнання таго, што тэхналогіі, звязаныя з ім, цяпер шырока распаўсюджаны, неабходнасць іх бяспечнага развіцця і захавання заўсёды ставячы патрэбы нашага віду на першае месца. цэнтр.

Затым пералічваецца шэраг магчымых рызык, некаторыя з якіх ужо былі правераны на месцах, звязаных з выкарыстаннем сістэм штучнага інтэлекту, у прыватнасці: рызыкі, звязаныя з правамі чалавека (праца, догляд, правасуддзе); рызыкі, звязаныя з абаронай прыватнасці; рызыкі, звязаныя з правільнай інфармацыяй (надзвычай надзейны кантэнт, які ўводзіць у зман); рызыкі, звязаныя з тэхналагічнымі «сінгулярнасцямі», звязанымі з штучным інтэлектам (новыя прарыўныя тэхналогіі ў адчувальных кантэкстах, такіх як біятэхналогіі і інфармацыйныя тэхналогіі).

У Швейцарыі Федэральная палітэхніка за празрысты і надзейны штучны інтэлект

Штучны інтэлект - гэта (таксама) рэвалюцыя ў рэдагаванні фатаграфій

Інавацыі і журналістыка: часта складанае суіснаванне

Кіраванне праблемай за межамі дзяржавы

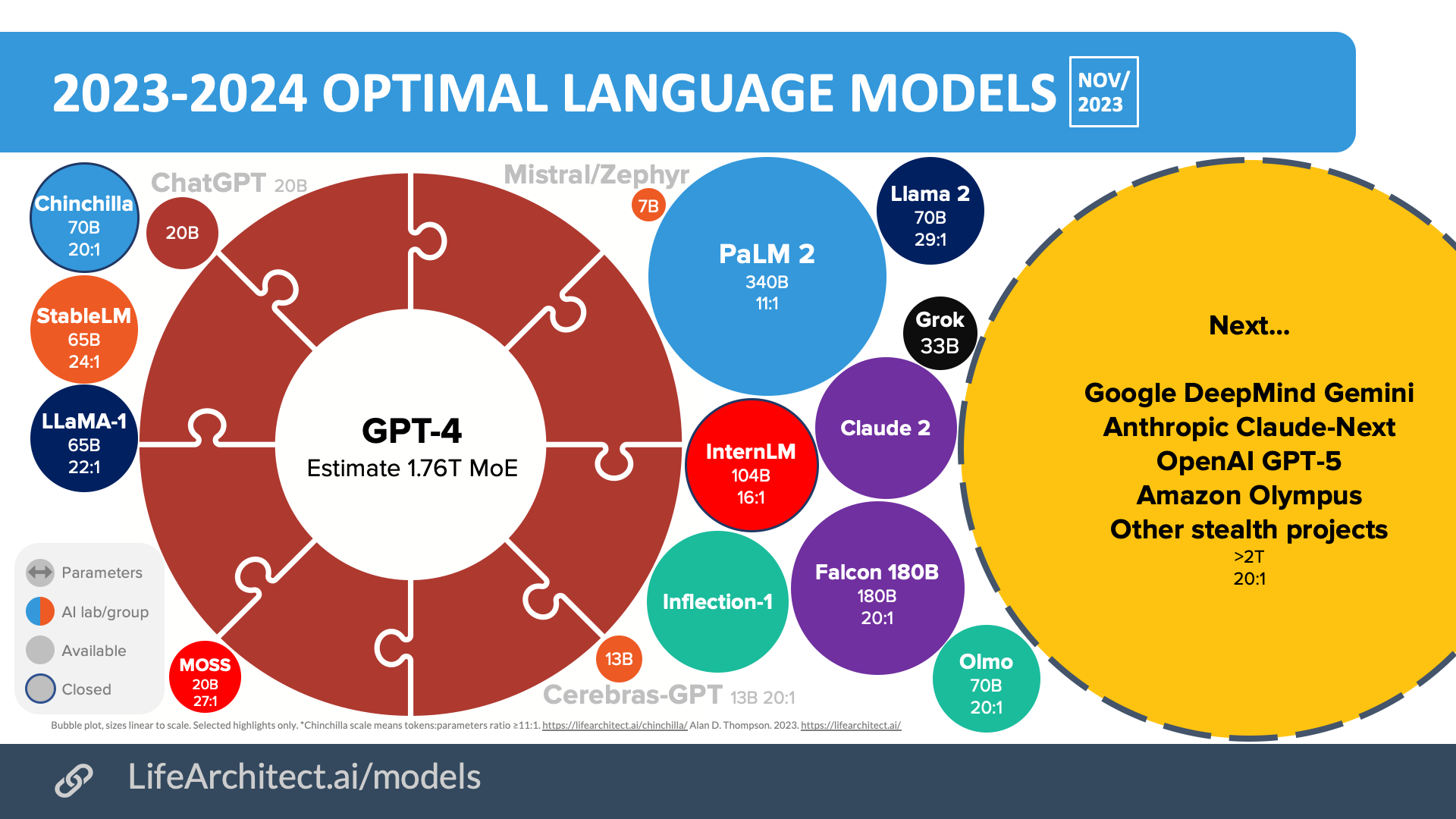

Паколькі многія з гэтых рызык носяць міжнародны характар, рэкамендуецца максімальнае супрацоўніцтва паміж дзяржавамі для іх вырашэння па меры іх узнікнення, а таксама актыўны ўдзел усіх суб'ектаў, пачынаючы з самых буйных і важных кампаній, такім чынам, здольных «навучыць» найбольш магутных AI, у бесперапынным, адкрытым і празрыстым параўнанні.

Такім чынам, на глабальным узроўні будзе створана сетка супрацоўніцтва з мэтай выяўлення рызык штучнага інтэлекту праз глабальны і агульны навуковы падыход, каб лепш зразумець яго ўплыў на грамадства і, адпаведна, выбудаваць агульную палітыку для вырашэння звязаных з гэтым змяненняў.

Майкл фон Ліхтэнштэйн пра геапалітыку і штучны інтэлект

Калі старасць - гэта мяжа падзелу паміж добрай і дрэннай тэхнікай

Лейтматыў Big Data «Дзён швейцарскай статыстыкі 2023»

Рызыкі сыходнага падыходу ў кіраванні тэмай

Некалькі галіновых экспертаў адзначаюць, што, акрамя добрых намераў і дэкларацый аб жаданні працягваць адкрытае абмеркаванне з усімі гульцамі, такі падыход «зверху ўніз» рызыкуе «звязаць рукі» толькі буйным кампаніям у сектары, замест гэтага пакідаючы меншыя і, такім чынам, цяжкія для кантролю арганізацыі, свабодныя для ўсіх.

Гэта рэаліі, якія будуць распаўсюджвацца ўсё больш і больш менавіта дзякуючы тым тэхналогіям, якія ў цяперашні час распрацаваны такімі кампаніямі, як Google і OpenAI, якія дазволяць больш персаналізаваць сістэмы штучнага інтэлекту дзякуючы аптымізацыі неабходных рэсурсаў, магчыма, якія працуюць у межах законнасці. .

Адным словам, як абвяшчае старажытнае кітайскае праклён, наперадзе цікавыя часы.

Той пастаянны скачок веры ў кіно Крыстафера Нолана

Дарожная карта для прасоўвання Ліхтэнштэйна як лічбавага цэнтра

У Фраўэнфельдзе AI запускае новы завод па сартаванні ПЭТ

Што сапраўды адбылося на саміце па бяспецы штучнага інтэлекту ў Блетчлі-парку 2023 года

Адкрыццё пленарнага пасяджэння саміту па бяспецы штучнага інтэлекту 2023 у Блетчлі-парку

Заключнае пленарнае пасяджэнне саміту па бяспецы штучнага інтэлекту 2023 г. у Блетчлі-парку

Пасланне караля Вялікабрытаніі Карла III да грамадскасці і арганізатараў саміту па бяспецы AI 2023

Вы таксама можаце быць зацікаўлены ў:

«Прадаю, а застаюся»: новы трэнд малога прадпрымальніка

Гісторыя ўваходжання Франчэска Шыціні і Emotec у фонд MCP з'яўляецца прыкладам частай змены ўласнікаў без арганізацыйных узрушэнняў

Альберта НікалініРэдактар Districtbiomedicale.it, BioMed News і Radio Pico

AI Tools for Businesses, курс, прысвечаны штучнаму інтэлекту

Швейцарскі стартап navAI распрацаваў яго з мэтай забеспячэння ўсіх інструментаў, неабходных для ўкаранення новай тэхналогіі ў сваім сектары

Быў бэкдор, каб заразіць іх усіх, але адзін геній выратаваў Інтэрнэт

Вось як веды распрацоўшчыка і крыху... прадбачлівасці толькі што прадухілілі сабатаж Linux і ўсяго Інтэрнэту

Абарона мораў у Грэцыі і пытанне Элінскага жолаба...

"Наша акіянічная канферэнцыя", Афіны створаць два новыя нацыянальныя марскія паркі і забароняць траленне, але існуе праблема паміж Эгейскім і Іанічным морам